"Wir brauchen eine menschenzentrierte Robotik"

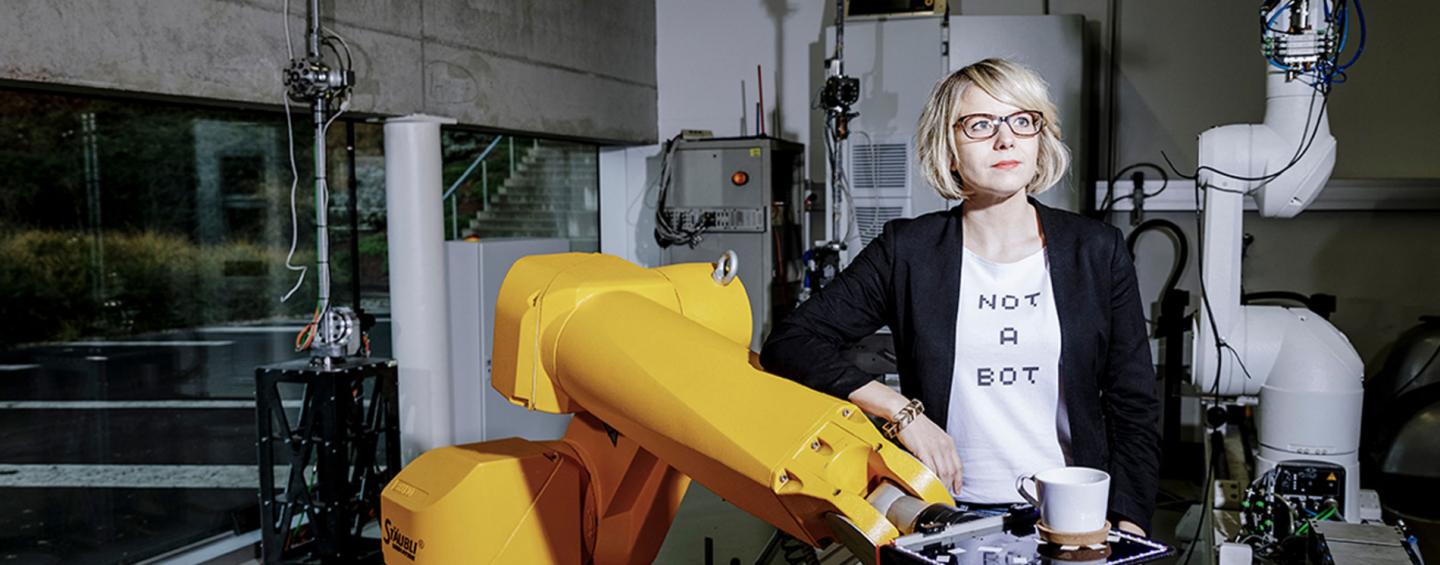

Weniger Angst, dafür eine intensivere gesellschaftliche Debatte: Roboterpsychologin Martina Mara fordert mehr Visionen für Robotik und Künstliche Intelligenz – und die Überbrückung der Gräben zwischen den Disziplinen.

Frau Mara, Sie sind Roboterpsychologin. Wen therapieren Sie?

Niemanden. Denn entgegen der allgemeinen Vorstellung vieler Menschen haben Roboter kein Bewusstsein und keine Psyche – und es gibt weltweit keinen einzigen Prototypen, der darauf hinweisen würde, dass so etwas in absehbarer Zeit möglich wäre. Meine wissenschaftliche Arbeit handelt davon, wie Menschen Roboter und Künstliche Intelligenz erleben und wie sie gestaltet werden müssen, dass wir sie akzeptieren. In der Zukunft werden mehr Maschinen an unserem Leben teilnehmen, ob das nun Alexa im Wohnzimmer oder das selbstfahrende Auto ist. Mein Anliegen ist eine menschenzentrierte Robotik, also menschliche Bedürfnisse inmitten der aktuellen technischen Transformation in den Mittelpunkt zu stellen und herauszufinden, wie wir eine sinnvolle Gemeinschaft hinkriegen.

Wie finden Sie das heraus?

Zum Beispiel freue ich mich besonders auf das CoBot Studio, ein neues Forschungsprojekt, das in Kürze anläuft. Aktuell werden sogenannte kollaborative Roboter immer wichtiger. Das sind Maschinen, die zum Beispiel in der Industrie gemeinsam mit Menschen arbeiten. Sie helfen beim Montieren, heben schwere Dinge oder prüfen gemeinsam mit Menschen Verpackungen.

Sind Roboter zu menschenähnlich, werden sie den Leuten sehr unheimlich.

Das CoBot Studio wird ein neuartiger Mixed-Reality-Simulationsraum, in dem wir virtuelle Arbeitsumgebungen mit echten kollaborativen Robotern kombinieren. Probanden werden mit den Robotern spielerisch im Team arbeiten. Wir möchten daraus lernen, wie diese Maschinen sich verhalten müssen, damit die Menschen gut mit ihnen arbeiten können und sich wohlfühlen. Zu unseren Ergebnissen kommen wir mit In-situ-Fragebögen, aber auch durch die Auswertung von Kamera- und Sensordaten.

Bis heute konzentrierte sich die Forschung und Entwicklung vor allem darauf, dass die Roboter Menschen richtig analysieren können. Als Technikpsychologin sage ich aber, dass wir bidirektional denken müssen. Um vertrauen zu können, wollen Menschen verstehen, was so ein Roboter demnächst tun wird. Denn Unvorhersehbarkeit ist Menschen oft unangenehm. Deshalb muss so ein Roboter eben nicht nur Menschen lesen, er muss auch seine Ziele gut kommunizieren können. Darüber hinaus erforsche ich, warum Menschen Angst vor Robotern haben.

Haben wirklich so viele Menschen Angst vor Robotern?

Ja. Es gibt viele Umfragen, die auf verschiedene große Ängste in Bezug auf Roboter und Künstliche Intelligenz hinweisen. Ich zitiere gerne die repräsentative Erhebung der Europäischen Kommission, bei der die Leute befragt wurden, in welchen Aufgabenbereichen sie Roboter prioritär einsetzen würden. 27 000 befragte Europäer gaben an, in der Weltraumforschung wären diese Roboter in Ordnung. Das sagt über die Haltung der Menschen viel aus, denn: Weiter weg als der Weltraum geht nun wirklich nicht. In den Bereichen, die uns Menschen als soziale Wesen definieren, ist die Akzeptanz der Menschen gegenüber Robotik häufig sehr gering. Also zum Beispiel in der Altenpflege oder Kinderbetreuung.

Auf dem Gelände des Science Park der Johannes Kepler Universität Linz

Was erschwert die Akzeptanz?

Ich habe mich lange mit dem 'Uncanny Valley', dem 'Unheimlichen Tal' befasst, einem Phänomen, das hier als eines von vielen eine Rolle spielt. Das Konzept beschreibt einen Zusammenhang zwischen der Menschenähnlichkeit eines Roboters und der emotionalen Reaktion des Menschen. Sind Roboter zu menschenähnlich, erschweren zum Beispiel Silikonhaut und künstliches Haar die Unterscheidung, werden sie den Leuten sehr unheimlich. Der Roboter kann Kopf und Augen haben, muss aber klar als Maschine erkennbar sein. Den Gruseleffekt konnte ich sehr oft live bei meiner Arbeit am Ars Electronica Futurelab in Linz erleben, wo wir humanoide Roboter ausgestellt hatten: Viele Leute sind regelrecht zurückgeschreckt.

Wie kommt es zu diesen Reaktionen?

Ganz einig ist sich die Forschung da noch nicht. Kategorienkonflikte dürften aber eine Rolle spielen, also das Nicht-Einschätzen-Können, was von meinem Gegenüber zu erwarten ist und ob es eher in die Schublade "Mensch" oder in die Schublade "Maschine" gehört.

In der Meeting-Ecke im Robopsychology Lab

Künstliche Intelligenz kann sehr viele Dinge nicht, die Menschen können

Was dazukommt, ist, dass menschenähnlich aussehende Roboter natürlich deutlich plakativer die Angst vor Substitution, also vor dem Ersetztwerden durch Technologie befeuern, als das mechanisch aussehende Maschinen oder virtuelle Bots tun.

Auch in der öffentlichen Repräsentation von Robotik und Künstlicher Intelligenz treffen wir häufig auf das hochemotionale Bild des allzu menschlichen Androiden. Medien verwenden es eigentlich ständig, vermitteln damit aber, dass der Mensch als gesamtes komplexes Wesen ersetzt werden könnte. Das ist reine Mythologie. Künstliche Intelligenz kann sehr viele Dinge nicht, die Menschen können und sie ist auch nicht mit Menschen vergleichbar. Entwicklern und Unternehmen, mit denen ich zusammenarbeite, empfehle ich daher häufig, von der Konkurrenzlogik wegzugehen und Mensch und Maschine noch stärker komplementär zu denken. Das soll dann natürlich nicht nur die äußere Gestalt, sondern auch die Aufgabenverteilung betreffen.

Das Keramikmaskottchen bekam Martina Mara anlässlich ihrer Antrittsvorlesung an der Universität Linz geschenkt.

Immerhin hat Stephen Hawking davor gewarnt, Künstliche Intelligenz könnte die Menschheit eines Tages auslöschen. Sind also die Bedenken nicht doch berechtigt?

Es gibt da gerade ein absurdes Hin und Her zwischen Leuten, die eine Dystopie voraussagen wie Hawking und anderen wie Mark Zuckerberg, die glauben, Künstliche Intelligenz werde alle Probleme der Menschheit lösen. Ich denke, mit solchen extremen Prognosen kann man nur falsch liegen.

Eine Künstliche Intelligenz hält uns einen Spiegel vor

Abseits von Science Fiction gibt es allerdings tatsächlich Probleme, die wir bei der aktuellen technischen Entwicklungsgeschwindigkeit nicht aus den Augen verlieren dürfen: Zum Beispiel sind die Daten, aus denen ein selbstlernender Algorithmus lernt, von Menschen gemacht, die Ziele, nach denen er lernt, von Menschen vorgegeben. Vor dem System selbst muss deshalb niemand Angst haben, eher davor, wie einzelne Menschen es nutzen oder welche Fehlannahmen wir den künstlichen Intelligenzen einspeisen.

Auf was sollte mehr geachtet werden?

Viel wichtiger als Terminator-Fantasien und dieses allgemeine Gestaune über Sexroboter wäre es, mal über unseren Qualitätsanspruch an Daten, anhand derer wir unsere KI-Systeme trainieren, zu diskutieren. Denn darin enthaltene Sichtweisen auf die Welt werden von Algorithmen natürlich reproduziert. Der Beruf des Datenkurators, der sich etwa um Repräsentativität und Fairness von KI-Trainingsdaten kümmert, wird in Zukunft daher enorm wichtig werden. Worauf man außerdem achten sollte, ist, dass viele Technik-Teams immer noch sehr jung, weiß und männlich sind. Es fehlt an Diversität.

In welchen Fällen kann das Probleme bereiten?

Firmen wenden in ihrer Personalabteilung schon jetzt Algorithmen an, um Bewerber zu sortieren und schneller entscheiden zu können, wer für ein Vorstellungsgespräch eingeladen wird oder nicht. Diese Systeme lernen aus Millionen unserer Texte mitsamt all unserer Stereotype. Eine Künstliche Intelligenz hält uns also einen Spiegel vor und zementiert im schlechtesten Fall gesellschaftliche Zustände. Zum Beispiel kann das System Frauen aussortieren, wenn es um den Posten eines Software-Ingenieurs geht. Einfach, weil es aus unseren Daten lernt, dass Frauen offenbar seltener Ingenieure sind. Amazon ist das übrigens gerade mit einer hauseigenen Software passiert. Die mussten den Algorithmus quasi feuern.

Sie plädieren dafür, Robotik und Künstliche Intelligenz positiver zu betrachten. Warum?

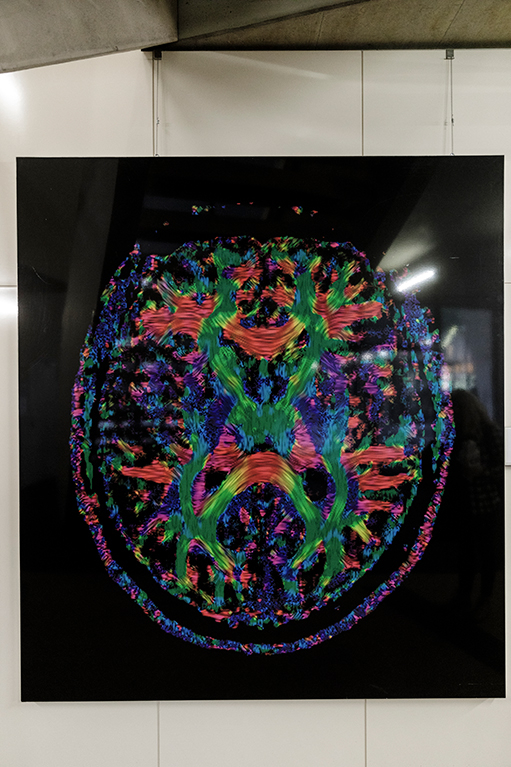

Vor allem realistischer. Wir sollten nicht in Furcht verharren und damit die Chance verpassen, die Richtung der Entwicklung zu bestimmen. Es gibt viele Bereiche, in denen die neuen Technologien eine große Chance sind. Interessanterweise bieten sie vor allem dann einen Vorteil, wenn Menschen und Maschinen einander ergänzen. Zum Beispiel in der medizinischen Diagnostik von Röntgenbildern: Da hat sich gezeigt, dass die Kombination aus der Erfahrung eines Mediziners und aus der Datenanalyse einer Künstlichen Intelligenz unschlagbar ist.

Auch in der Pflege von alten Menschen könnte die Robotik eine Entlastung bringen. Allerdings nicht als streichelnder und Zuneigung simulierender Android, sondern zum Beispiel als Exoskelett, das Pflegern beim schweren Heben den Rücken stützt oder als Transportroboter, der Wäsche von A nach B bringt. Das Pflegepersonal muss sich dann nicht mehr den Rücken ruinieren und hätte mehr Zeit für das, was Menschen immer besser können werden als Maschinen: Kommunizieren, Verständnis aufbringen. Es ist wichtig für uns als Gesellschaft, positive Visionen von der Zusammenarbeit mit neuen Technologien zu entwickeln – und sie auch daran auszurichten. Dafür brauchen wir die Zusammenarbeit unterschiedlichster wissenschaftlicher Disziplinen.

Magnetresonanz-Aufnahme des menschlichen Gehirns im Gang vor dem Robopsychology Lab.

Sie arbeiten viel mit Kollegen aus anderen Fachrichtungen zusammen. Ist das manchmal schwierig?

Ich halte diese Zusammenarbeit mit Programmierern, Ingenieuren, Künstlern, Philosophen oder sogar Gaming-Experten in meinem Fall für unabdingbar – und ich persönlich liebe das auch. Allerdings habe ich durch meine berufliche Sozialisation viele Jahre Erfahrung mit interdisziplinären Teams. Ich kann mittlerweile meine Art zu sprechen ganz gut anpassen und verwende je nach Gegenüber andere Fachtermini. Generell sollte es aber wohl universitäre Kurse mit dem Inhalt "Interdisziplinäre Verständigung" geben, denn die Vorurteile und Gräben sind teilweise wirklich tief. In meinem Linzer Institut habe ich schon angeregt, dass in Zukunft zumindest unsere Studiengänge der Psychologie und der Artificial Intellligence gemeinsame Lehrveranstaltungen haben – sozusagen als interkulturelles Training.